Pourquoi revendre ses données personnelles est une énorme c…

mardi 30 janvier 2018 à 14:03Le Think-tank Génération Libre vient de publier un rapport sur les données personnelles. Dans ce dernier, particulièrement libéral, les auteurs proposent « d’instaurer une patrimonialité des données personnelles », un « droit de propriété sur les données », afin de pouvoir vendre, ou non, ses données personnelles.

Nous allons nous demander si l’idée de monétiser ses données personnelles est bonne ou pas. Spoiler : c’est une aberration.

Données personnelles, c’est-à-dire ?

Pour commencer, il est nécessaire de se demander à quoi « données personnelles » se réfère. La réponse, vous allez le voir, n’est pas si simple.

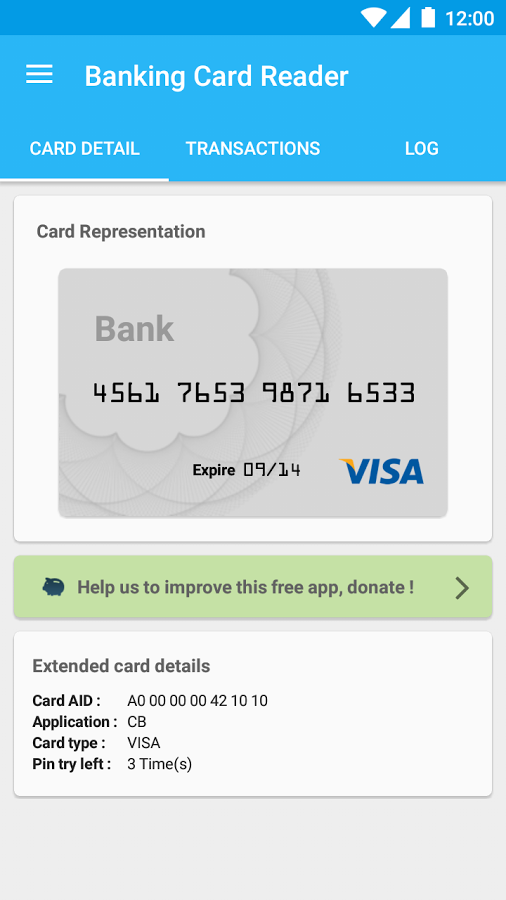

On retrouve la définition des données personnelles « réglementaire », à savoir « toute donnée qui permet directement ou indirectement d’identifier un individu ». Pêle-mêle, on parle de votre âge, votre sexe, du lieu de naissance, de votre adresse, de tout ce qui a un rapport direct ou indirect à vous.

Indirect signifie qu’il est également question des métadonnées, qui sont, pour rappel, « toutes les données qui gravitent autour du contenu principal, de la donnée » : l’heure d’envoi d’un sms, le temps passé à un endroit, la fréquence de contact avec une personne, le temps d’un appel, la destination d’un message, vos données de navigation, etc. Ces éléments permettant une identification indirecte.

Le caractère indirect des données personnelles doit nous faire prendre conscience d’une chose : certaines données « personnelles » sont davantage des données « communes », reliées à d’autres personnes que vous.

Partant de ce principe, revendre des données personnelles revient, parfois, voire souvent, à vendre aussi celles des autres. Or, vous n’êtes pas en droit de décider pour d’autres personnes, encore moins quand-il est question de revente…

Une donnée personnelle, ça vaut combien ?

C’est une question à laquelle il n’y a pas de réponse. Certains s’accordent à dire que la revente de vos données personnelles rapporterait une dizaine d’euros par ans, au mieux.

Il faut comprendre que vos données, seules, et sauf votre respect, ne sont pas intéressantes. Non pas qu’on se fiche de votre vie, mais c’est la somme des données et le croisement de ces dernières qui est intéressant, rien d’autre. Un système devient intéressant s’il est basé sur des milliers de données, alors bon, vos données et uniquement vos données, « on s’en moque ». Pensez global et non individuel.

Définir la valeur d’une donnée personnelle est d’autant plus compliqué qu’en fonction de l’usage ou de l’instant, elle peut avoir plus ou moins de valeur : votre géolocalisation n’intéressera que très peu un acteur X, mais énormément un acteur Y.

Faudrait-il vendre deux fois ses données, à deux prix différents, à deux entreprises différentes ?

On commence à entrevoir l’énorme problème technique créé par cette idée de revente des données personnelles.

Qui dit revente, dit contractualisation de l’échange, donc acte inscrit « dans le marbre ». Or, qui rédigera le contrat ? Sera-t-il possible de le modifier ? Existera-t-il des clauses permettant de revenir en arrière et, si oui, seront-elles vraiment efficaces ? Et que faire si je ne veux plus que mes données soient utilisées ?

Il est encore possible de se demander si la cession des données personnelles à, disons, Facebook, ne vas pas aussi concerner Instagram ou WhatsApp.

Que faire si je décide de vendre mes données à Facebook mais pas à Instagram ou WhatsApp ?

Bref, un gros problème insoluble, si ce n’est en multipliant les contrats partout, en direct ou via des intermédiaires, avec les marques et les GAFA.

N’oublions pas non plus que contractualiser cette revente signifie lire des documents. La majorité des utilisateurs ne lisent pas les conditions générales d’utilisations, faute de temps et parfois, de capacité, certaines CGU étant imbuvables.

Pourquoi cela serait différent avec un contrat qui ne sera sans doute pas à notre avantage ?

Clôturons cette partie en parlant de la valeur « morale » ou « sentimentale » d’une donnée : la vie privée, l’intimité, est composée d’un ensemble de facteurs et de données personnelles.

Chaque personne accorde une importance différente aux pans ce cette intimité. Ainsi, certains ne voient pas de problèmes à exposer leurs scores dans des jeux vidéo, là où d’autres si. Certains ne voient pas de problèmes à exposer des aspects extrêmement intimes de leurs vies, là où d’autres s’y opposent fermement.

Un contrat, par définition, ne s’attache pas à la valeur qu’on donne à une donnée. Il est impensable que les GAFA (ou les autres) éditent des contrats sur-mesure, donc individuels. Un prix sera fixé par donnée, probablement arbitrairement, point.

Une boite de Pandore à ne pas|jamais ouvrir

Si ces idées de monétisation venaient à devenir la norme, la loi, alors il y a fort à parier que d’autres s’engouffreraient dans le précédent créé par ce changement.

Pour illustrer le propos, parlons un peu des assurances : le principe des assurances et la mutualisation des risques. En tant qu’assuré, vous payez une cotisation, ou prime d’assurance.

Cette cotisation vous protège financièrement des risques ou des dommages qui touchent ce qui est assuré (maison, voiture, etc.). Ce sont les cotisations qui font que vous êtes remboursé, non pas en fonction de qui vous êtes, mais en fonction du contrat auquel vous avez souscrit. Vous payez donc pour les autres, et les autres payent pour vous pour que, le jour venu, l’assurance puisse vous aider. C’est un principe de solidarité fondamental dans le monde de l’assurance.

Seulement, il y a fort à parier que les assurances seraient extrêmement intéressées par la revente des données personnelles, qui pourrait les conduire à un principe d’individualisation des assurances.

Vous pensez que c’est une bonne chose ? Détrompez-vous.

Votre hygiène de vie n’est pas exemplaire 24h/24 et l’information est transmise par votre montre connectée ? L’assureur pourrait vous faire payer plus cher. Vous vous appelez Mohamed et pas Julien ? L’assureur pourrait également vous faire payer plus cher, comme le démontre cet exemple. C’est une rupture franche de l’égalité que nous avons dans ces systèmes assurantiels.

On peut certes se dire que le principe n’est pas mauvais, puisqu’il tend à prendre « soin » de nous… mais en faisant cela, il mène aussi à une forme très violente d’autocensure, où (ne pas) faire certaines activités reviendrait à prendre des risques. Comme je l’ai dit de nombreuses fois ici, avoir quelqu’un qui vous observe constamment modifie obligatoirement votre comportement, même inconsciemment.

Ce n’est pas un problème d’argent

Enfin, et surtout, ce rapport laisse penser que l’exploitation des données personnelles n’est, au final, qu’un banal problème de rémunération des producteurs de données, à savoir nous.

L’exploitation des données personnelles, l’intrusion brutale dans les composantes de nos vies privées, n’est pas un problème d’argent. C’est un problème éthique et éminemment politique. La vision de Génération Libre est partielle, voire erronée. En ne solutionnant que l’aspect financier dans la gestion des données personnelles, on ramène l’utilisateur final, nous, à une simple question d’acceptation ou de refus de signer. Et Génération Libre de confirmer le propos en filigrane, dans son rapport :

« Mais au regard des faits actuels, est-ce que la soi-disant non patrimonialisation des données empêche une quelconque exploitation abusive de ses données ? Voyons-nous une baisse du nombre d’usurpations d’identité ? Force est de constater que non. On voit au contraire que le cyber-citoyen est désapproprié de son droit d’abusus. »

Nous sommes désappropriés de nos droits, nos données ne nous appartiennent déjà plus, fin du game ?

Exit les combats politiques, les propositions de loi, amendements, les luttes sur le terrain, les appels et les mails, les billets de blog, les personnes expertes, tout cela ne sert à rien puisque le combat est déjà perdu ?

Je ne peux être qu’en désaccord avec la vision de Génération Libre, la simple existence de ce billet exprime la force de mon désaccord.

Effectivement, le contrôle de nos données personnelles est de plus en plus difficile, les menaces qui pèsent sur notre intimité sont de plus en plus nombreuses et il n’y a pas une semaine sans une nouvelle découverte d’un abus, d’un problème ou d’une faille relative à nos données personnelles. Pour autant, quitte à marteler, la réponse à cela n’est pas, et ne peut pas être, purement et simplement financière.

Je vous invite à lire, et à partager, l’excellent billet « Revendre ses données « personnelles », la fausse bonne idée », de Mais où va le WEB. Son analyse est détaillée, avec des sources et elle est bien plus neutre que la mienne, bien que nos points de vue se rejoignent.

Je vous invite également à lire le tout aussi excellent article d’Olivier Ertzscheid, sur son blog : Faut pas prendre les usagers des GAFAM pour des Datas sauvages.

Et vous, vous en pensez quoi ?

PS : le rapport est téléchargeable… en échange d’une adresse mail. A qui j’envoie la facture ?